在湖南這片科技創新熱土上,湖南科技學院化學與生物工程學院的趙雄杰教授,正以其深厚的學術積淀與敏銳的產業洞察,帶領團隊在新材料技術的研發與推廣服務領域默默耕耘,將實驗室的“智慧結晶”轉化為驅動地方產業升級的現實生產力,生動詮釋了“科院智慧”的時代內涵。

潛心科研,攻克技術瓶頸

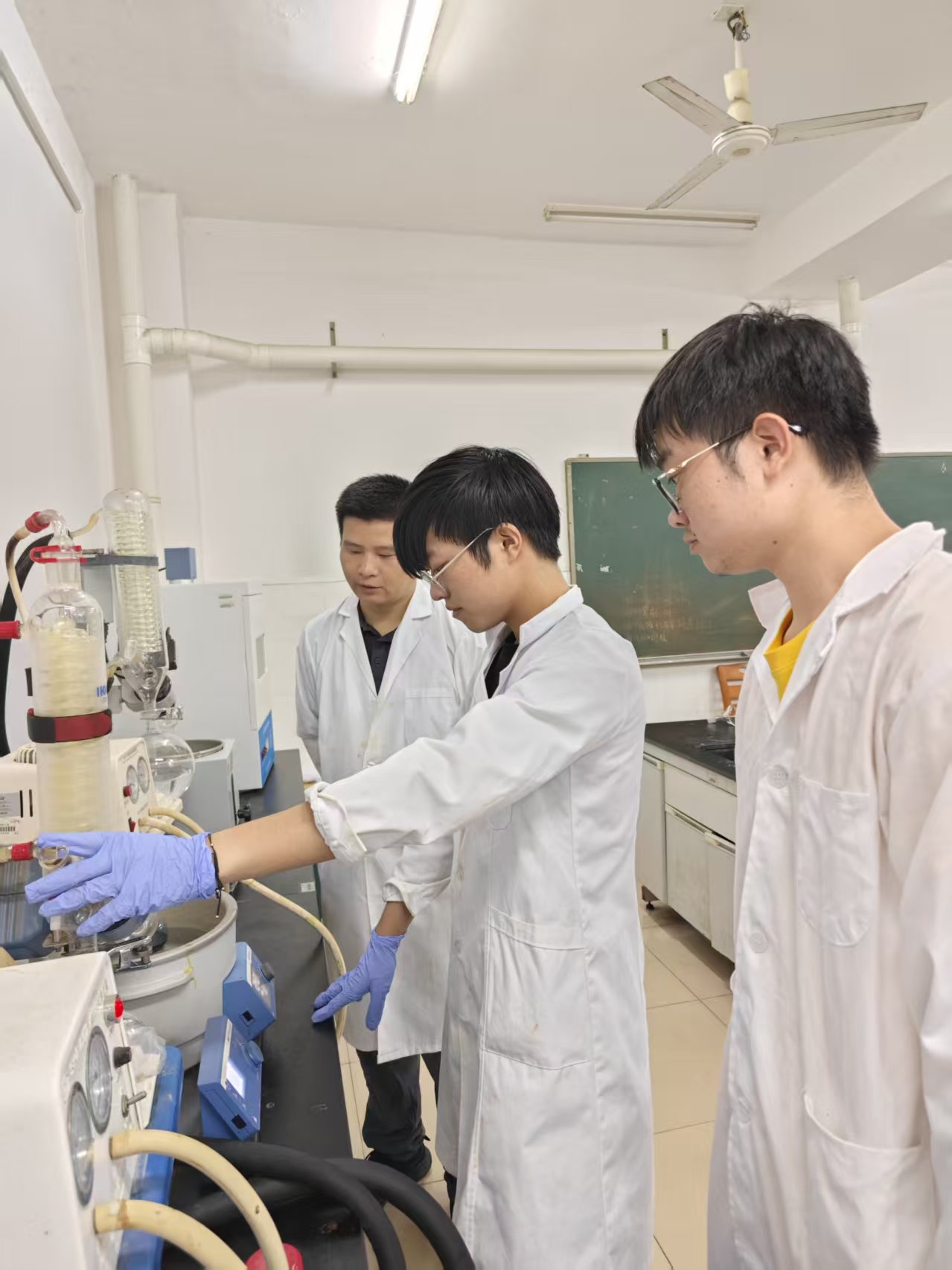

趙雄杰教授長期致力于功能新材料的基礎與應用研究。面對國家戰略性新興產業發展和區域經濟轉型對關鍵材料的迫切需求,他帶領團隊瞄準高性能、環境友好型新材料的制備與改性技術,開展了一系列前沿性、攻關性研究。實驗室里,無數次實驗、分析與論證,見證了團隊在分子設計、合成工藝優化及性能調控等方面取得的突破。這些扎實的科研工作,為后續的技術轉化奠定了堅實的理論與技術基礎。

聚焦轉化,打通“最后一公里”

深知科研成果不能止步于論文和專利,趙雄杰教授積極推動產學研深度融合。他主動對接省內新材料、新能源、生物醫藥等相關企業,深入生產一線調研技術難題與市場需求。針對企業具體的工藝改進、產品升級或降本增效需求,他帶領團隊提供“定制化”的技術解決方案,將實驗室成果進行中試放大和工藝包開發,有效解決了從實驗室到產業化生產線之間的“最后一公里”難題。這種以需求為導向、以問題為牽引的成果轉化模式,顯著提升了科技服務的精準性與有效性。

服務地方,賦能產業發展

趙雄杰教授及其團隊的新材料技術推廣服務,已成為連接學院科研優勢與地方產業需求的重要橋梁。他們不僅為企業提供技術咨詢、工藝診斷和人員培訓,還積極參與地方產業規劃,為區域新材料產業集群的培育與發展提供智力支持。通過技術轉讓、合作開發等多種形式,多項新材料技術已在相關企業實現落地應用,幫助企業提升了產品競爭力,創造了可觀的經濟效益,同時也為區域經濟的綠色、創新發展注入了新的科技動能。

言傳身教,培育創新人才

在推動科技攻關與成果轉化的趙雄杰教授始終堅守育人初心。他將科研項目、技術推廣實踐與人才培養緊密結合,鼓勵并指導學生參與實際課題研究和技術服務過程。在這種“做中學、學中做”的氛圍中,學生不僅夯實了專業知識,更培養了創新思維、工程實踐能力以及服務社會的意識,一批具備扎實技能和開拓精神的青年科技人才正在成長。

從實驗室的潛心鉆研到生產一線的精準服務,趙雄杰教授用行動展現了新時代高校科研工作者的使命與擔當。他和團隊在新材料技術領域的持續探索與有效推廣,正是“科院智慧”服務地方、貢獻社會的生動寫照。隨著更多科技成果的涌現與轉化,這份“智慧”必將為“智匯瀟湘”、為建設現代化新湖南貢獻更為磅礴的力量。